Pas d’intelligence artificielle sans une maîtrise complète des maths et des statistiques

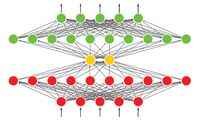

De nos jours, bonne ou mauvaise, l’intelligence artificielle est perçue comme une technologie d’avant-garde et des termes comme réseaux de neurones sont souvent synonymes de prouesses technologiques. Cette approche n’a rien de nouveau. Dans les années 80, les scientifiques du domaine de l’imagerie et de l’audio digital — nouveau à l’époque — espéraient utiliser une architecture particulière de réseau de neurones, appelée auto-encodeurs, pour coder et transmettre les informations pertinentes contenues dans un signal. Ce processus semblait prometteur non seulement pour transmettre ces informations, mais aussi pour potentiellement augmenter la qualité du signal décodé en sortie.

En 1988, Hervé Bourlard, aujourd’hui responsable du groupe de recherche Speech & audio processing, et son collègue de l’époque, Y. Kamp, ont publié un article de référence dans le domaine. Ils y ont démontré que le codage de signal avec les réseaux de neurones pouvait être effectuée tout aussi bien avec des outils mathématiques usuels de l’algèbre linéaire. Cette découverte a non seulement expliqué comment fonctionnent les auto-encodeurs, mais a également mis fin à certaines spéculations quant au fait que les réseaux de neurones auto-encodeurs peuvent extraire à partir de rien certaines caractéristiques-clés du signal encodé.

Progrès futurs

Aujourd’hui, plus de trois décennies plus tard, les auto-encodeurs ne sont pas morts. Ils sont utilisés dans de nombreux domaines allant de la reconnaissance faciale au traitement d’images. C’est pourquoi Hervé Bourlard et sa collègue Selen Hande Kabil ont décidé de poursuivre les recherches de l’article publié en 1988.

Les chercheurs ont exploré l’approche mathématique en l’étendant à d’autres techniques utilisées communément et ayant des architectures d’auto-encodeur plus complexes. Ils ont également inclus un autre type de signal, appelé entrées discrètes. Cette généralisation est très pertinente, dans la mesure où les auto-encodeurs sont particulièrement utilisés dans le domaine des entrées discrètes, comme par exemple pour le traitement du langage naturel. Dans ce cas, souvent, le but est d’analyser la proximité sémantique entre des mots dans un contexte donné pour déterminer leur lien.

En analysant plus en détails ces résultats dans le cadre de nouvelles architectures, plus complexes et appliquées à des bases de données plus larges — qui n’existait pas en 1988 —, les scientifiques ont confirmé à nouveau que l’algèbre linéaire génère souvent des solutions optimales ou, au moins, permet de mieux comprendre et d’améliorer les réseaux de neurones. « C’est un petit pas, mais qui est crucial pour rendre plus explicable l’intelligence artificielle. Habituellement, le traitement de données par cette technologie constitue souvent une boîte noire. Cette absence de possibilité pour comprendre les mécanismes en jeu mine la confiance dans le résultat final », explique Hervé Bourlard.

Au-delà du fait que cette publication cimente la théorie des réseaux de neurones en analysant leur fonctionnement, les chercheurs espèrent que cette approche mathématique inspirera la prochaine génération de scientifiques pour questionner les outils qu’ils utilisent quotidiennement. De plus, « si l’usage des mathématiques et des statistiques est une alternative aux auto-encodeurs énergivores utilisés pour certaines tâches, il existe alors un potentiel pour des solutions technologiques plus économes en énergie », conclut Hervé Bourlard.

Plus d’informations

- Groupe de recherche Speech & audio processing

- “Autoencoders reloaded”, Hervé Bourlard & Selen Hande Kabil, 2022

- “Auto-association by multilayer perceptrons and singular value decomposition”, by Hervé Bourlard, Y. Kamp, in Biol Cybern, 1988